从零开始的Python爬虫速成指南

1、0.准备工作

需要准备的东西: Python、scrapy、一个IDE或者随便什么文本编辑工具。

2、 1.技术部已经研究决定了,你来写爬虫。

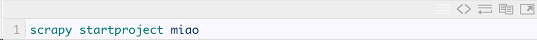

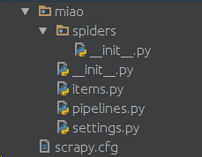

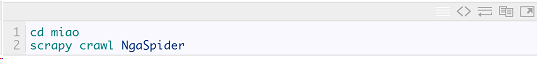

随便建一个工作目录,然后用命令行建立一个工程,工程名为miao,可以替换为你喜欢的名字。

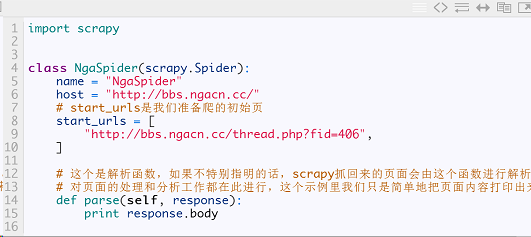

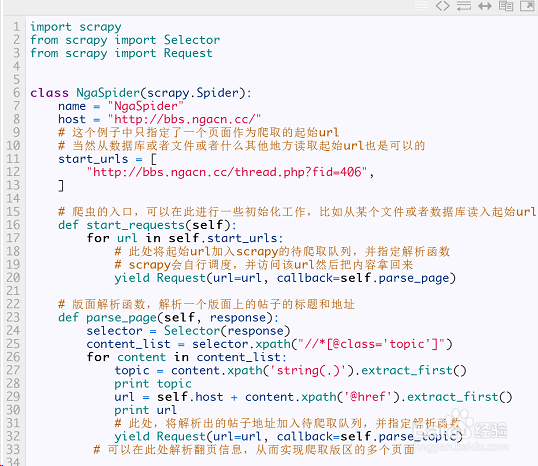

4、 在spiders文件夹中创建一个python文件,比如miao.py,来作为爬虫的脚本。 内容如下:

2、 你可以看到爬虫君已经把你坛星际区第一页打印出来了,当然由于没有任何处理,所以混杂着html标签和js脚本都一并打印出来了。

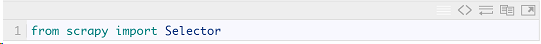

1、 接下来我们要把刚刚抓下来的页面进行分析,从这坨html和js堆里把这一页的帖子标题提炼出来。 其实解析页面是个体力活,方法多的是,这里只介绍xpath。

2、 0.为什么不试试神奇的xpath呢

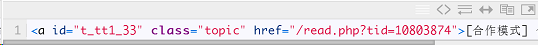

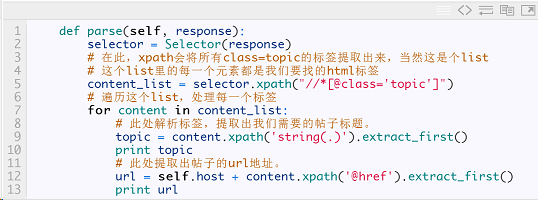

看一下刚才抓下来的那坨东西,或者用chrome浏览器手动打开那个页面然后按F12可以看到页面结构。 每个标题其实都是由这么一个html标签包裹着的。举个例子:

3、 可以看到href就是这个帖子的地址(当然前面要拼上论坛地址),而这个标签包裹的内容就是帖子的标题了。 于是我们用xpath的绝对定位方法,把class='topic'的部分摘出来。

3、 再次运行就可以看到输出你坛星际区第一页所有帖子的标题和url了。

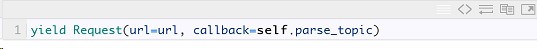

1、 接下来我们要抓取每一个帖子的内容。 这里需要用到python的yield。

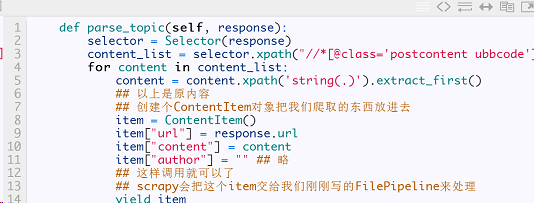

2、 此处会告诉scrapy去抓取这个url,然后把抓回来的页面用指定的parse_topic函数进行解析。

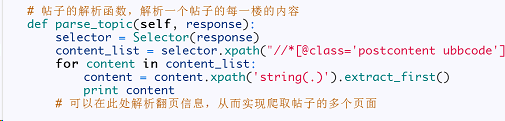

至此我们需要定义一个新的函数来分析一个帖子里的内容。

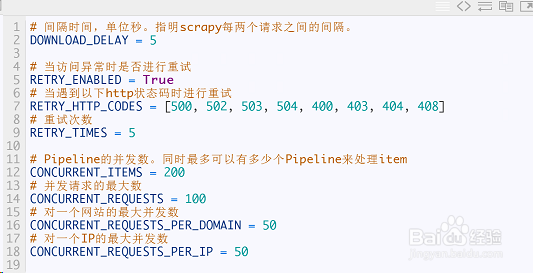

3、 到此为止,这个爬虫可以爬取你坛第一页所有的帖子的标题,并爬取每个帖子里第一页的每一层楼的内容。 爬取多个页面的原理相同,注意解析翻页的url地址、设定终止条件、指定好对应的页面解析函数即可。

4、 Pipelines——管道

此处是对已抓取、解析后的内容的处理,可以通过管道写入本地文件、数据库。

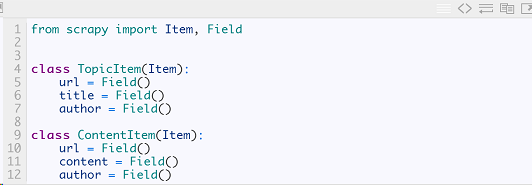

5、 0.定义一个Item

6、 此处我们定义了两个简单的class来描述我们爬取的结果。

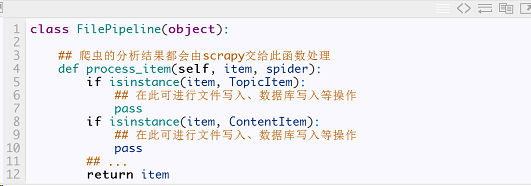

1、 在miao文件夹下面找到那个pipelines.py文件,scrapy之前应该已经自动生成好了。

1、 要调用这个方法我们只需在爬虫中调用即可,例如原先的内容处理函数可改为:

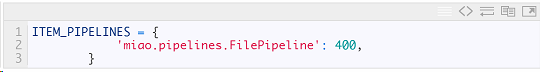

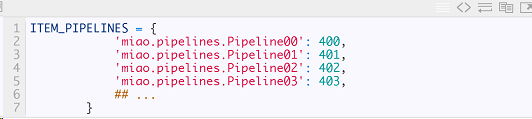

2、 这样在爬虫里调用的时候都会由经这个FilePipeline来处理。后面的数字400表示的是优先级。 可以在此配置多个Pipeline,scrapy会根据优先级,把item依次交给各个item来处理,每个处理完的结果会传递给下一个pipeline来处理。

1、 通过Middleware我们可以对请求信息作出一些修改,比如常用的设置UA、代理、登录信息等等都可以通过Middleware来配置。

2、 0.Middleware的配置

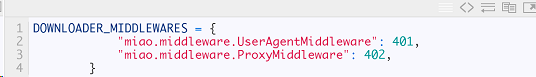

与pipeline的配置类似,在setting.py中加入Middleware的名字,例如

3、 1.破网站查UA, 我要换UA

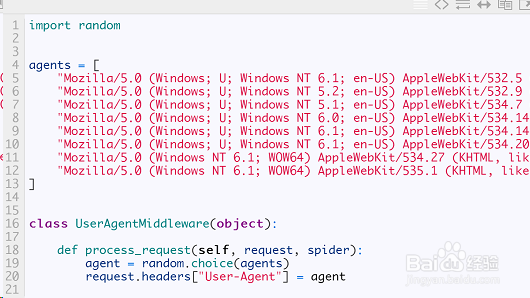

某些网站不带UA是不让访问的。 在miao文件夹下面建立一个middleware.py

4、 这里就是一个简单的随机更换UA的中间件,agents的内容可以自行扩充。

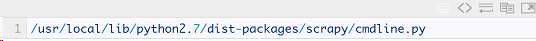

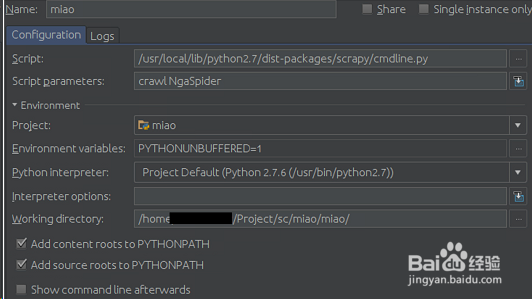

1、 如果非要用Pycharm作为开发调试工具的话可以在运行配置里进行如下配置: Configuration页面: Script填你的scrapy的cmdline.py路径,比如我的是

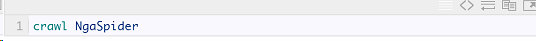

2、 然后在Scrpit parameters中填爬虫的名字,本例中即为:

3、 最后是Working diretory,找到你的settings.py文件,填这个文件所在的目录。 示例:

4、 另外从广义讲,Python不仅是一门编程语言,还是一个编程的平台,在这个平台下,有着安装各种扩展、框架的工具pip,有着打包工具setuptools等等等等,这些工具已经很成熟,而且易于上手,另外Python有很多很好的编程工具(集成开发环境)可以用,如PyCharm等,这也使的新人很容易上手,不像其他不成熟的编程语言工具贫乏,编写和运行程序如连电路板一般。